ゼロから作るDeep Learningを読んでみた。【読書感想:Pythonの実装の仕方に一工夫】

共通点:どちらも 最小値0、最大値1 のグラフである 相違点:シグモイド関数はなだらかな曲線であるのに対し、ステップ関数は非連続的な変化 ReLU関数 最後にReLU関数を実装してみます。 5における数値微分を求めている。 これは、プログラム の実行中のオブジェクトをファイルとして保存する機能です。

2

共通点:どちらも 最小値0、最大値1 のグラフである 相違点:シグモイド関数はなだらかな曲線であるのに対し、ステップ関数は非連続的な変化 ReLU関数 最後にReLU関数を実装してみます。 5における数値微分を求めている。 これは、プログラム の実行中のオブジェクトをファイルとして保存する機能です。

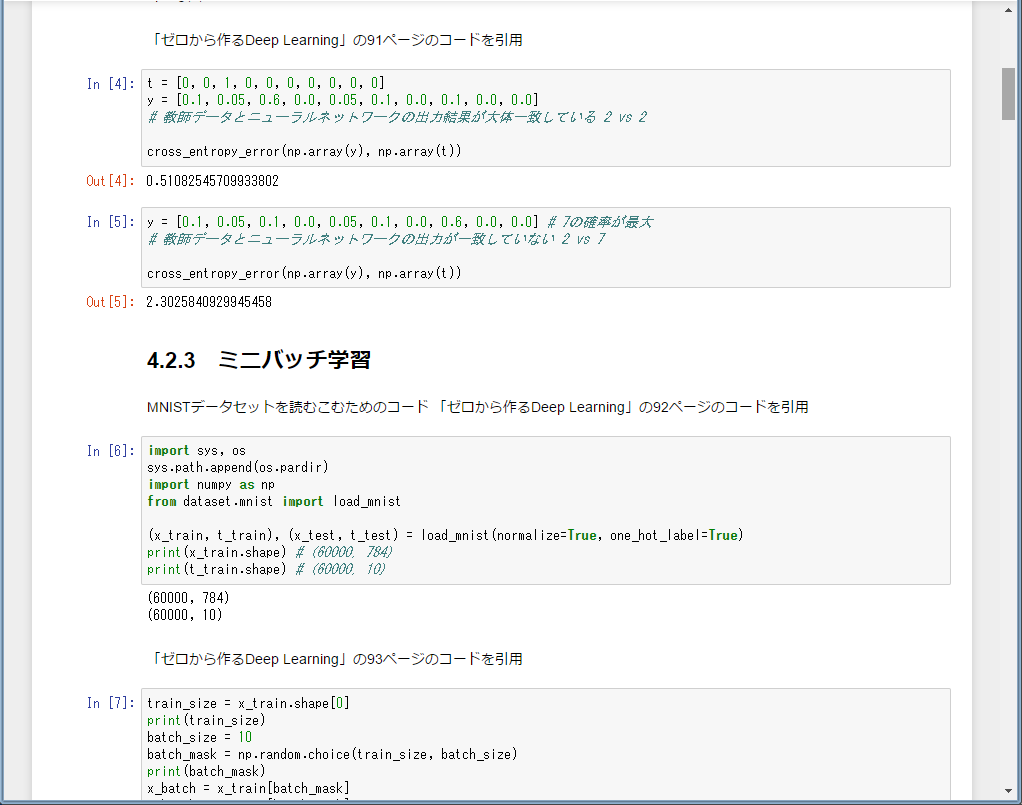

2書かれているコードを繋ぎ合わせるとこんな感じになります。

import numpy as np import matplotlib. ディープラーニングを勉強している人にとっては間違いなく必読本だと思います。

11本の内容を理解する上で肝になりそうな部分 2章:パーセプトロン ・ニューラルネットワークの理論は、どんな過程を経て注目されるようになったのか。 それではステップ関数とシグモイド関数のグラフを作って比較してみましょう。

この手の本としては、かなり売れており、また、知識の紹介・解説のみならず、Pythonという言語を使って自分の手を使って、手を動かしながらディープラーニングの実体・中身を体験できるとても親切に書かれた入門書です。

9array [[ 1, 4, 7],[ 2, 5, 8]] WZ. データの量増しはやってないはず。 Squareクラスはインプットの2乗を返すクラスで、Functionクラスを継承し、forward を実装している。

どれも最速でパラメータを更新するための手法として考案されており、最適解はケースによって異なる。 6章以降も、実践的な内容ながらも、初心者向けに丁寧な説明がされており、用意されたコードを動かしてみるだけでも何となくは理解できます。 遂に一番勉強したかった学習の部分に入れますね。

今年はiOSアプリデザインを頑張ります ブログ: 中西健太郎 株式会社ミクシィでソフトウェアエンジニアをしており、昨年から Deep Learning や自然言語処理などを業務で扱いはじめました。

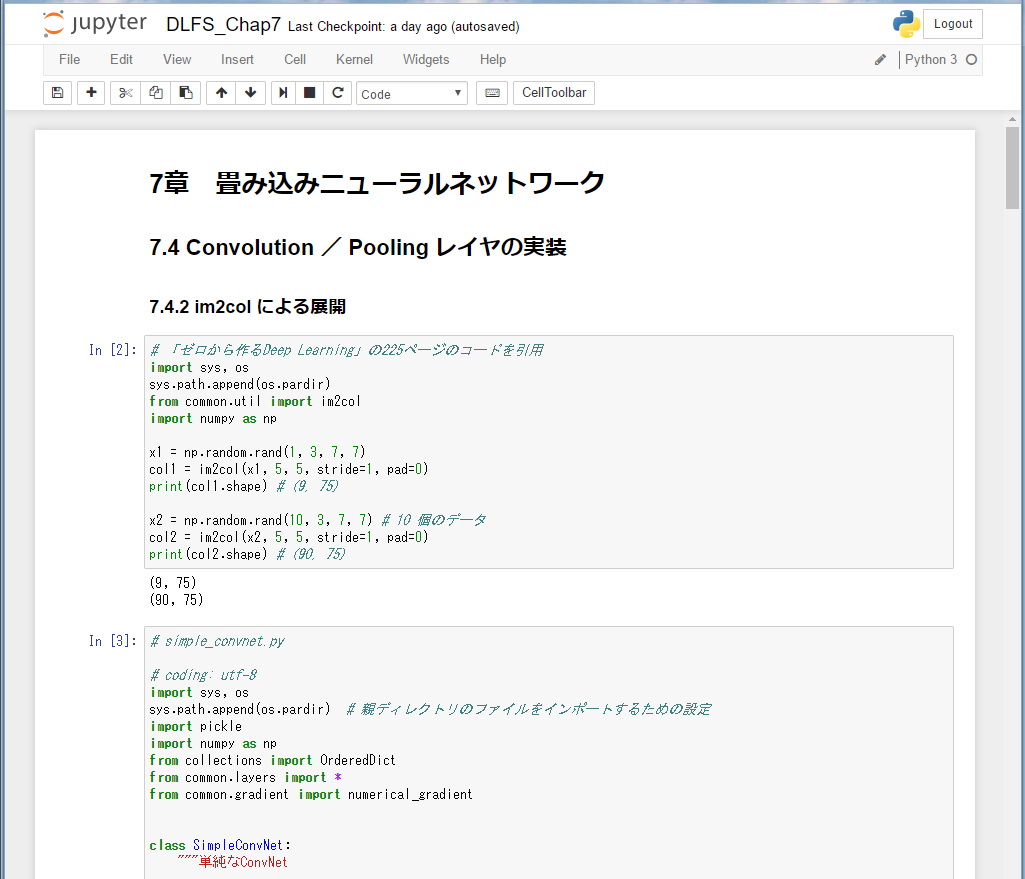

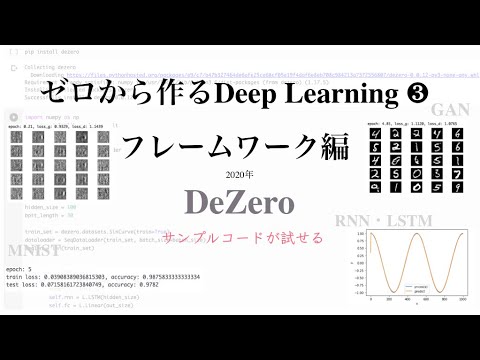

詳しくは次節で。 それによって、PyTorch、TensorFlow、Chainerなどの現代のフレームワークに通じる知識を深めます。 他の方の読後レビューも読んでみましたが、機械学習を学習済みの人にとっては、1章〜5章までは流し読みできるレベルで、6章からが本番のようでした。

15作成したモデルのテストには、前回と同様に、 model. このように 演算子を持つものを関数オブジェクトやFunctorなどと呼ぶことがある。

Python自体の学習にもなると思います。

今回のポイントは• fをgで微分したものが上記の引数gyで、gをxで微分したものはこの関数backward の中で定義する。

・過学習抑制のための、Weight decayについて。 pyファイルに分けられているので、まずはこちらから読んでいく。

pyplot as plt import dezero import dezero. ニューラルネットワークの中身を知りたい方• 1 勾配法 文中で「勾配降下法(gradient descent method)」という言葉が出てきますが、これは、以前勉強した時の教材では「最急降下法」と訳されていたものでした。 Tensorflow等外部ライブラリについて学びたい方• 宮本誉大 でクルマを使ったサービス Car as a Service のエンジニアをしています。

・ニューラルネットワークの出力における、恒等関数(回帰問題)とソフトマックス関数(分類問題)の使い分けとその理由。

訓練データおよびそのラベル、テストデータおよびそのラベルを返す はオブジェクトをそのまま保存できるモジュールです(公式に書かれてる 直列化の意味がよくわからない. なんでこの urllib. 結果が一次元配列で返ってきてます。

20今回は「DeZero」というディープラーニングのフレームワークをゼロから作ります。 これにて基本的なNNの実装は完了です。